Google Utmanar AI-Marknaden med Nya TPU 8 AI-Acceleratorer

Google har introducerat sina senaste TPU-chips, TPU 8t och TPU 8i, under Cloud Next-konferensen. Dessa AI-acceleratorer markerar en betydande förändring genom att övergå från x86 till Arm-baserade Axion-kärnor, vilket lovar att förbättra både träningshastigheter och kostnadseffektivitet för AI-modeller.

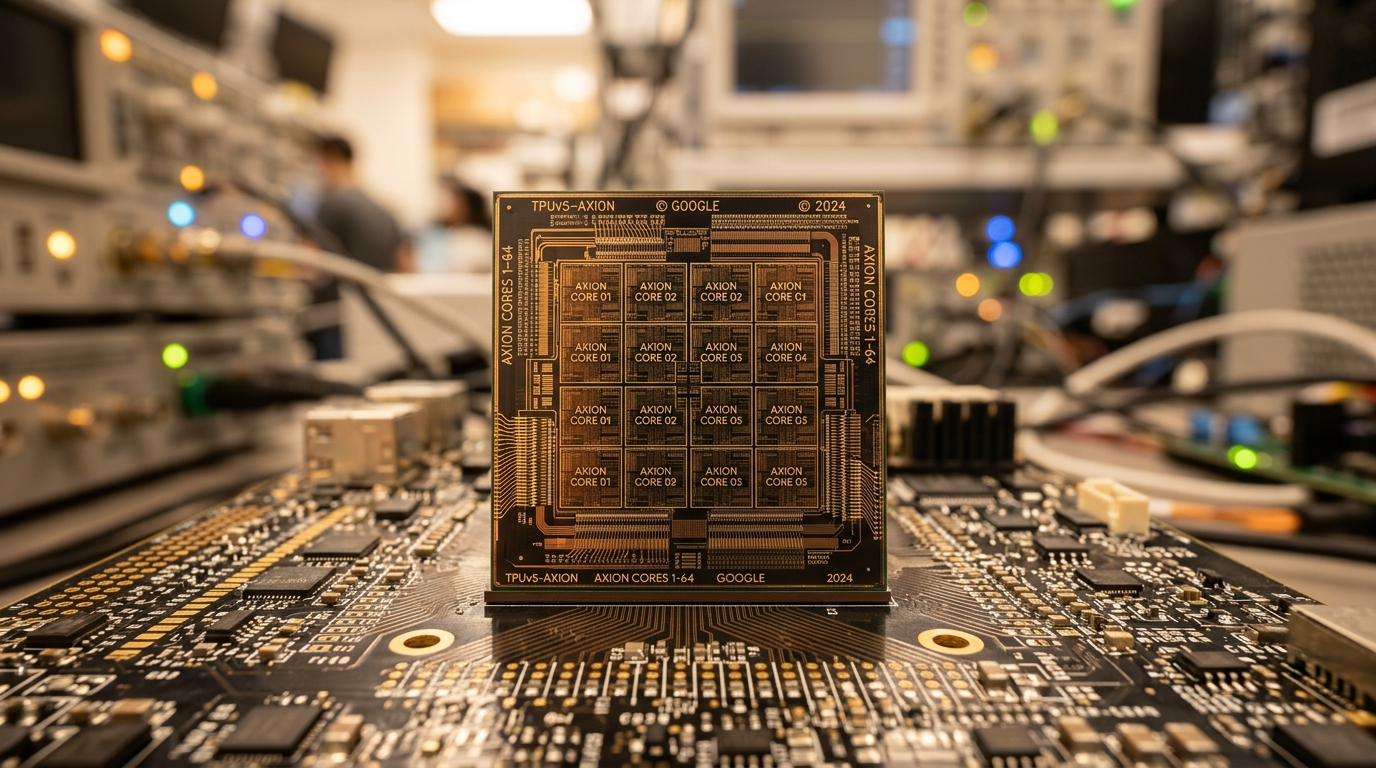

AI-genererad bild

Google har under sin årliga Cloud Next-konferens i Las Vegas lanserat två nya AI-acceleratorer, TPU 8t och TPU 8i, som båda är designade för att optimera olika aspekter av AI-arbete. Denna lansering markerar ett viktigt steg framåt i AI-kapplöpningen, där Google nu tar ett tydligt avstånd från den traditionella x86-arkitekturen till förmån för sina egna Arm-baserade Axion-kärnor.

TPU 8t är särskilt inriktad på att förstärka träningsprocessen för stora språkmodeller (LLMs), medan TPU 8i är optimerad för inferens, vilket innebär att den är designad för att effektivt hantera realtidsresonemang och modellkörning. Denna specialisering av chips är inte helt ny; andra aktörer som Amazon Web Services har också erkänt vikten av anpassade acceleratortyper för olika AI-uppgifter. Dock är Googles djupgående specialisering särskilt anmärkningsvärd.

Tekniskt sett erbjuder TPU 8t upp till 12,6 petaFLOPS av 4-bitars flyttalsberäkningar och är utrustad med 216 GB högbandbreddsminne (HBM) som ger en bandbredd på 6,5 TB/s. Detta gör det möjligt för TPU 8t att hantera stora och komplexa träningsuppgifter med hög effektivitet. Jämfört med Nvidias Rubin GPU, som erbjuder 35 petaFLOPS av FP4-träningsprestanda, kan Google-chipsen verka mindre imponerande individuellt, men deras styrka ligger i skalbarheten över flera enheter.

Övergången från x86 till Arm-baserade kärnor är en strategisk manöver som kan leda till betydande kostnadsbesparingar och ökad prestanda för AI-projekt. Arm-arkitekturen är känd för sin energieffektivitet och skalbarhet, vilket gör den särskilt attraktiv för företag som behöver hantera stora mängder data i sina AI-applikationer. För företag i Sverige och Norden, där AI-investeringar fortsätter att växa, kan denna utveckling erbjuda nya möjligheter att minska kostnader och öka effektiviteten i AI-baserade lösningar.

Sammanfattningsvis visar Googles nya TPU 8-acceleratorer på en tydlig riktning mot mer specialiserad och kostnadseffektiv AI-hårdvara. Genom att kombinera avancerad teknik med strategiska designval positionerar sig Google starkt i det pågående AI-kapploppet, vilket kan ha långtgående effekter på hur AI utvecklas och implementeras globalt, inklusive här i Norden.

FAKTAKOLL: Notering — TPU 8t och TPU 8i är inte nämnda i källmaterialet som specifika produkter.; Det finns ingen information om 'Axion-kärnor' i källmaterialet.; Det finns ingen specifik jämförelse med 'Nvidias Rubin GPU' i källmaterialet.

// Källor och vidare läsning

Artikeln baseras på följande publika källor. Vi rekommenderar att du följer länkarna för att läsa originalrapporteringen och primärkällor.

- go.theregister.comhttps://go.theregister.com/feed/www.theregister.com/2026/04/22/google_tpu8_dual_track_training_inference/

- cloud.google.comhttps://cloud.google.com/blog/products/compute/tpu-8t-and-tpu-8i-technical-deep-dive

- cnbc.comhttps://www.cnbc.com/2026/04/22/google-launches-training-and-inference-tpus-in-latest-shot-at-nvidia.html

Albert Promtsson

Albert Promtsson

// Kommentarer (0)