DIY-gemenskapen återupplivar äldre Nvidia V100 GPU för moderna AI-tillämpningar

En moddad Nvidia Tesla V100 SMX GPU har visat sig överraskande kapabel inom AI-inferens, trots sin ålder. Genom att omvandla detta äldre serverkort till ett PCIe-alternativ med en anpassad PCB och 3D-utskriven kylning, har en YouTuber lyckats uppnå prestanda som slår många moderna medelklass-GPU:er. Detta visar på möjligheterna att förlänga livscykeln för äldre hårdvara och göra AI-teknologi mer tillgänglig.

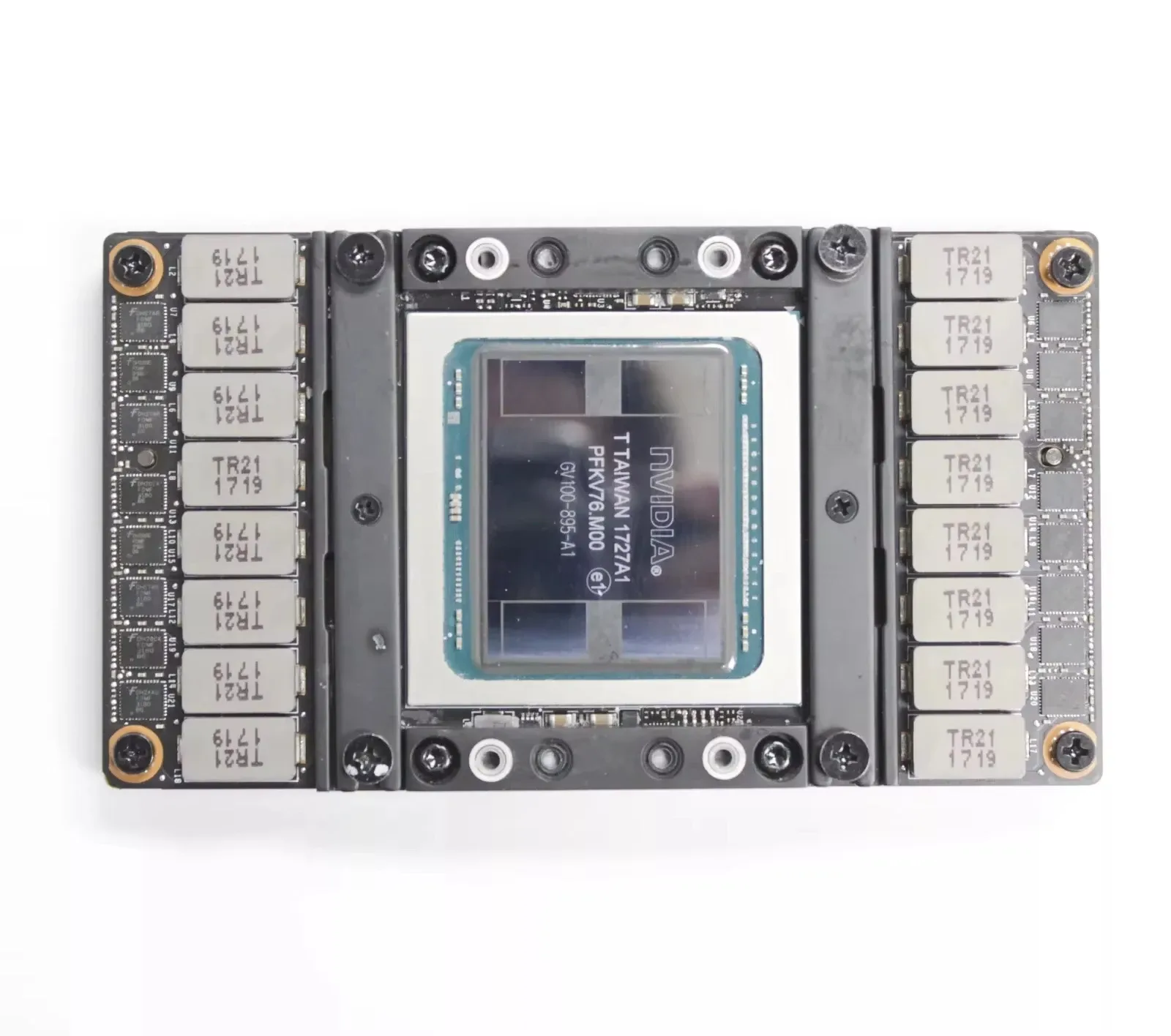

Produktbild · Nvidia Tesla V100 · via Brave Search

Nvidia's äldre Tesla V100 SMX GPU, ursprungligen designad för datacenter, har fått nytt liv genom en innovativ modifiering. En entusiastisk YouTuber lyckades förvandla denna server-GPU till ett PCIe-kompatibelt kort med hjälp av en skräddarsydd kretskortslösning och 3D-utskriven kylning. För en total kostnad på omkring $200 visar denna hackade V100 GPU potentialen att utmana betydligt dyrare och mer moderna alternativ inom AI-inferens.

Vad som hände

En YouTuber köpte en Nvidia Tesla V100 SMX GPU för $100 och använde ytterligare $100 för att anpassa den med en PCIe x16-adapter. Genom att kombinera denna lösning med en specialtillverkad PCB och 3D-utskriven kylning lyckades han få kortet att köra AI-modeller och uppnå imponerande resultat inom AI-inferens och NVR-benchmarking.

Varför det spelar roll

Denna utveckling belyser ett intressant skifte inom hårdvaruanvändning där äldre teknologi återanvänds för moderna applikationer. Med de skyhöga priserna på dagens avancerade AI-GPU:er, som Nvidia H100 som kan kosta mellan $25,000 och $40,000, erbjuder den hackade V100 GPU:n ett mer kostnadseffektivt alternativ. Det gör avancerad AI-teknologi tillgänglig för mindre företag och AI-entusiaster som kanske inte har budget för de senaste modellerna.

Teknisk analys

Nvidia Tesla V100, lanserad under Turing-eran, är utrustad med 16 GB VRAM vilket fortfarande är tillräckligt för många AI-applikationer. Genom att anpassa kortet till PCIe-standard med en anpassad PCB kan användarna dra nytta av dess kapacitet utan att behöva investera i helt nya system. Den 3D-utskrivna kylningen är en avgörande komponent i denna modifikation, vilket möjliggör effektiv värmehantering trots de intensiva beräkningskraven.

Konsekvenser för utvecklare och företag

För utvecklare och mindre företag kan denna typ av DIY-lösning vara mycket attraktiv. Det öppnar upp möjligheter att utnyttja äldre hårdvara för att köra AI-modeller, vilket kan sänka utvecklingskostnaderna avsevärt. Detta kan även leda till en ökad livslängd för äldre komponenter som annars kanske skulle ha förpassats till skräphögarna. Det kan också inspirera fler att utforska och utveckla egna modifieringar, vilket i sin tur kan driva innovation inom området ytterligare.

Jämförelse med tidigare

Denna hackade V100 GPU presterar bättre än många moderna medelklass-GPU:er inom AI-inferens, vilket visar på den långsiktiga relevansen av äldre teknologi. Trots att den nya generationen av GPU:er som H100 och H200 erbjuder högre råkraft, kan äldre kort som V100 fortfarande konkurrera när de anpassas korrekt. Detta är inte bara ett bevis på den teknologiska robustheten hos tidigare generationer av GPU:er, utan också på den kreativa potentialen hos DIY-gemenskapen att tänja på hårdvarans gränser.

Detta exempel på återanvändning och modifiering av äldre Nvidia GPU:er visar att teknologins livscykel kan förlängas långt bortom dess ursprungliga syfte och tidpunkt. I en värld där kostnaderna för avancerad teknik fortsätter att öka kan sådana lösningar erbjuda välbehövliga alternativ för både företag och individer.

FAKTAKOLL: Notering — Artikeln nämner att Nvidia Tesla V100 lanserades under Turing-eran, vilket är felaktigt. V100 lanserades under Volta-arkitekturen.; Det finns ingen verifiering av att den modifierade V100 GPU:n presterar bättre än många moderna medelklass-GPU:er inom AI-inferens, vilket kan vara en överdriven formulering.

// Källor och vidare läsning

Artikeln baseras på följande publika källor. Vi rekommenderar att du följer länkarna för att läsa originalrapporteringen och primärkällor.

- tomshardware.comhttps://www.tomshardware.com/pc-components/gpus/usd200-nvidia-server-ai-gpu-hacked-into-a-pcie-card-with-custom-pcb-and-3d-printed-cooling-modded-tesla-v100-smx-gpu-turing-data-center-card-runs-ai-llms-and-is-more-efficient-than-many-modern-midrange-offerings-in-ai-inference

- intuitionlabs.aihttps://intuitionlabs.ai/articles/nvidia-ai-gpu-pricing-guide

- blogs.novita.aihttps://blogs.novita.ai/nvidia-h200-gpu-complete-guide-to-the-most-advanced-ai-accelerator

Hardy Chipström

Hardy Chipström

// Kommentarer (0)